2023년 '마이아 100' 공개 이후 3년만

TSMC 3㎚ 공정 기반…HBM3e 메모리 적용

높은 추론 효율성…"달러당 성능 30% ↑"

자체 SDK도 공개…엔비디아 쿠다 겨냥

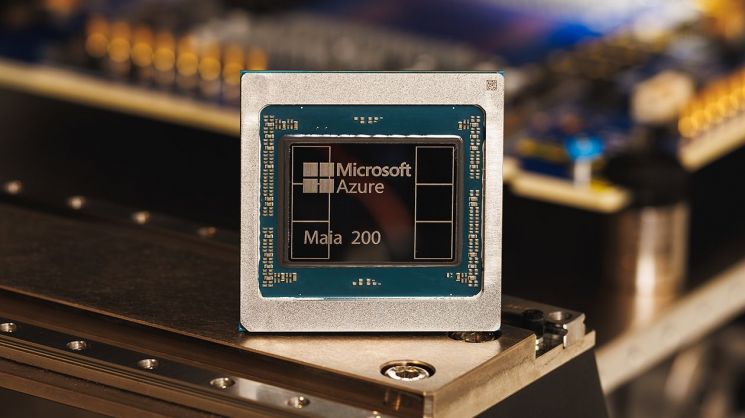

마이크로소프트(MS)는 인공지능(AI) 추론 작업의 효율성을 높인 AI 가속기 '마이아 200'(Maia 200)을 공개했다고 27일 밝혔다. 마이아 200은 MS의 클라우드 플랫폼인 애저(Azure) 환경에서 AI 추론 모델의 구동을 지원할 예정이다.

마이아 200은 TSMC의 3나노미터(㎚) 공정을 기반으로 고성능 AI 추론에 최적화된 구조를 갖췄다. 특히 초당 7테라바이트(TB) 대역폭의 216GB HBM3e 메모리 시스템과 네이티브 FP8/FP4 텐서 코어, 데이터 이동 엔진을 한데 묶었다. 이를 통해 거대 모델에 최적화된 추론 성능을 제공한다는 게 MS의 설명이다.

마이크로소프트(MS)는 인공지능(AI) 추론 작업의 효율성을 높인 AI 가속기 '마이아 200(Maia 200)'을 공개했다고 27일 밝혔다. 마이아 200의 제품 이미지. 한국마이크로소프트 제공

마이크로소프트(MS)는 인공지능(AI) 추론 작업의 효율성을 높인 AI 가속기 '마이아 200(Maia 200)'을 공개했다고 27일 밝혔다. 마이아 200의 제품 이미지. 한국마이크로소프트 제공

실제 연산 성능에서도 경쟁 AI 가속기들을 앞섰다. 마이아 200은 4비트 정밀도(FP4) 기준으로 아마존웹서비스(AWS)의 자체 AI 칩인 아마존 트레이니움(3세대) 대비 3배 높은 처리량을 기록했고, 8비트 정밀도(FP8)에서도 구글의 7세대 텐서처리장치(TPU)를 웃돌았다.

연산의 효율성도 높였다. 사티아 나델라 MS 최고경영자(CEO)는 "업계 최고의 추론 효율성을 위해 설계된 이 제품은 현존 시스템 대비 달러당 성능이 30% 높다"고 설명했다.

마이아 200은 대규모 AI 연산을 위해 1400억개 이상의 트랜지스터를 탑재했다. 이를 통해 대규모 모델 구동을 지원함과 동시에 차세대 모델까지 구동할 수 있는 수준의 성능 여유가 있다는 게 MS의 설명이다. 아울러 데이터 공급 병목 현상 해결을 위해 메모리 하위 시스템을 전면 재설계해 토큰 처리량을 최적화했다.

데이터센터에 설치하고 운영하는 과정도 최적화했다. 백엔드 네트워크와 액체 냉각 시스템을 조기 검증하고 통합해 마이아 200의 입고부터 데이터 센터 배치까지의 기간을 기존 대비 절반 이하로 줄였다.

마이아 200은 오픈AI의 최신 모델인 GPT-5.2를 비롯한 다양한 모델을 지원한다. MS는 마이아 200을 자체 모델 개선과 강화학습에 투입할 예정이다. 고품질 도메인 데이터의 생성과 필터링 속도를 높여 후속 학습을 위한 주요 역할을 맡게 된다.

마이아 200은 미국 아이오와주의 MS 데이터센터에 이미 설치됐다. 이후 애리조나주 피닉스의 데이터센터에도 설치해 애저 클라우드 이용 고객에게 제공할 예정이다.

MS가 자체 칩을 내놓는 건 2023년 11월 '마이아 100'의 공개 이후 2년여 만이다. 다만 마이아 100은 MS 애저 클라우드에 탑재, 내부용으로만 사용돼 시장 파급력이 제한적이었다. 당시 MS는 자체 칩 시장에서 경쟁사인 아마존이나 구글보다 성과가 늦다는 평가를 받아왔다.

업계는 마이아 200이 사실상 MS의 첫 상용화 칩이라고 평가하고 있다. MS는 마이아200을 통해 엔비디아의 그래픽처리장치(GPU)에 대한 의존을 낮추려 할 것으로 보인다.

지금 뜨는 뉴스

한편, MS는 모델의 활용을 지원하기 위한 '마이아 200 소프트웨어 개발 도구(SDK)' 프리뷰도 공개했다. 이 SDK는 엔비디아의 쿠다(CUDA) 소프트웨어에 대응, 마이아 200의 소프트웨어 생태계를 확장하는 역할을 할 것으로 보인다. 쿠다는 엔비디아의 AI 개발자용 도구로, GPU를 AI 연산에 활용할 수 있도록 지원한다. 엔비디아는 쿠다를 통해 자체적인 AI 개발 생태계를 구축하고 있다.

이명환 기자 lifehwan@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>