텍스트·이미지·음성 등 처음부터 학습

다양한 영역의 AI 에이전트 구현 목표

네이버클라우드는 정부의 '독자 AI 파운데이션 모델' 구축 프로젝트 일환으로 추진 중인 '옴니(Omni) 파운데이션 모델' 개발 과제의 첫 번째 성과를 29일 오픈소스로 공개했다. 하이퍼클로바X 기반의 이 모델을 통해 일상과 산업 현장에서 누구나 활용할 수 있는 AI 에이전트 구현을 본격화한다는 계획이다.

네이버클라우드는 국내 최초로 네이티브 옴니모달 구조를 적용한 파운데이션 모델인 '네이티브 옴니모델'과 기존 추론형 AI에 시각·음성·도구 활용 역량을 더한 '고성능 추론모델'을 각각 오픈소스로 공개했다.

네이티브 옴니모델은 텍스트·이미지·오디오 등 여러가지 데이터를 단일 모델에서 처음부터 함께 학습한 모델이다. 옴니모달 AI는 말과 글, 시각·음성 정보가 복합적으로 오가는 현실 환경에서 활용도가 높은 차세대 기술로 주목받고 있다. 이러한 특성으로 인해 글로벌 빅테크 기업들 역시 옴니모달을 차세대 파운데이션 모델의 핵심 기술 축으로 삼고 있다.

네이버클라우드는 옴니모달 AI의 잠재력을 극대화하기 위해 기존 인터넷 문서나 이미지 중심의 학습을 넘어 현실 세계의 다양한 맥락을 담은 데이터 확보에 집중한다는 전략이다.

성낙호 네이버클라우드 기술 총괄은 "모델을 대규모로 키워도 데이터 다양성이 한정되어 있다면 AI의 문제 해결 능력도 특정 영역 또는 특정 과목에만 집중돼 나타날 수밖에 없다"며 "이에 디지털화되지 않은 생활 맥락 데이터나 지역의 지리적 특성이 반영된 공간 데이터 등 차별화된 현실 세계 데이터를 확보하고 정제하는 과정이 선행돼야 한다"고 설명했다.

이미지 생성·편집은 텍스트와 이미지의 맥락을 함께 이해해 의미를 반영한 결과물을 만들어내는 방식으로 이뤄진다. 예를 들어, 야외에서 카메라를 든 인물 사진을 업로드한 뒤 '이 카메라를 든 사람이 찍었을 것 같은 풍경을 사진으로 그려줘'라고 요청하면 인물이 카메라 렌즈를 통해 보고 있는 풍경 사진을 결과물로 내놓는 식이다.

이와 함께 공개된 '고성능 추론모델'은 자체 추론형 AI에 시각 이해, 음성 대화, 도구 활용 능력을 결합해 복합적인 입력과 요청을 이해하고 문제를 해결하는 옴니모달 에이전트 경험을 구현했다.

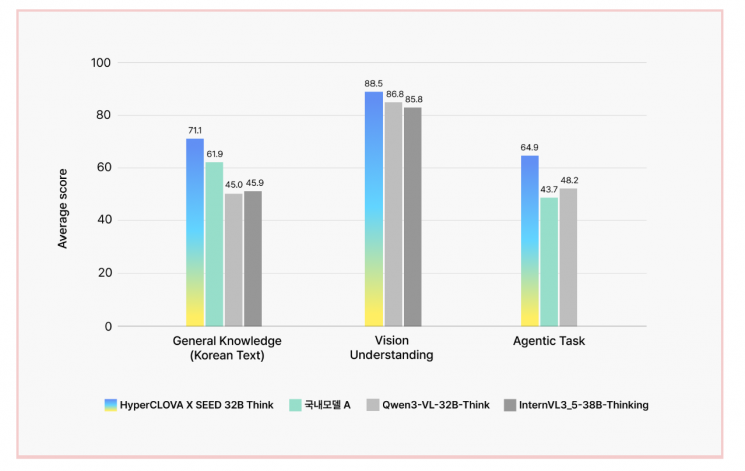

해당 모델은 글로벌 AI 평가 기관인 '아티피셜 애널리시스'가 종합 지식·고난도 추론·코딩·에이전트형 과제 등 10개 주요 벤치마크를 종합해 산출한 지수 기준에서도 글로벌 주요 AI 모델들과 유사한 성능 범위에 위치한 것으로 나타났다.

특히 한국어 기반 종합 지식, 시각 이해, 실제로 도구를 활용해 문제를 해결하는 에이전트 수행 능력 등 주요 능력 항목에서 글로벌 모델들과 비교해 우수한 성능을 기록했다.

올해 대학수학능력시험 문제를 풀이한 결과, 국어·수학·영어·한국사 등 주요 과목에서 모두 1등급에 해당하는 성과를 거뒀으며, 영어와 한국사에서는 만점을 기록했다. 회사 측은 다수의 AI 모델이 문제를 텍스트로 변환해 입력해야 하는 방식과 달리, 해당 모델은 이미지 입력을 직접 이해해 문제를 해결했다는 점에서 차별화된다고 덧붙였다.

성 총괄은 "텍스트·시각·음성 등 AI의 감각을 수평적으로 확장하는 동시에 사고와 추론 능력을 함께 강화했을 때 현실 문제 해결력이 크게 높아진다는 점을 확인했다"며 "이러한 기본기를 갖춘 구조 위에서 점진적으로 규모를 확장해야 실제로 쓰임새 있는 AI로 발전할 수 있다고 보고 이를 토대로 스케일업을 이어갈 계획"이라고 말했다.

네이버클라우드는 이번 모델을 기반으로 검색·커머스·콘텐츠·공공·산업 현장 등 다양한 영역에서 활용 가능한 AI 에이전트를 단계적으로 확장하며, 모두의 AI 실현을 위한 기술 생태계 구축에 속도를 낼 계획이다

김보경 기자 bkly477@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![전문가 4인이 말하는 '의료 생태계의 대전환'[비대면진료의 미래⑥]](https://cwcontent.asiae.co.kr/asiaresize/319/2026013014211022823_1769750471.png)

!['두쫀쿠 폭풍' 올라타 1000만개 판매 '역대급 실적' 이 기업…증권가 주목[주末머니]](https://cwcontent.asiae.co.kr/asiaresize/308/2026021018115837041_1770714718.jpg)