21세기 인류가 직면한 거대한 변화 중 첫손으로 꼽을 수 있는 인공지능과 관련해 최근 그 법적 책임에 대한 많은 논의가 이루어지고 있다. 인공지능도 인간이 만든 소프트웨어로서 도구에 불과한데 책임 문제가 새삼 제기되는 것은, 딥러닝에 의한 인공지능의 작동 과정에 인간이 통제할 수 없는 블랙박스 영역이 있기 때문이다. 즉 인공지능이 왜 이런 결정을 하고 이렇게 작동하는지 인간이 알 수도 없고 통제할 수도 없으므로 그 인공지능을 만들거나 활용한 자의 책임도 부당하다는 것이 논란의 핵심이다. 이 문제에 대한 바람직한 해결책을 고민하던 차 철학과 심리학 분야의 뜨거운 쟁점인 자유의지 논쟁에서 실마리를 찾을 수도 있겠다는 생각이 들었다.

자유의지 논쟁이란 인간에게 자유의지라고 할 만한 것이 있느냐를 두고 긍정론과 부정론으로 갈려 무려 2500년간 다투어 온 것을 말한다. 상식적인 차원에서는 인간이 자신의 의사로 선택을 하고 그 선택에 대한 윤리적·법적 책임을 진다는 것이 너무도 당연한데 철학자 중에는 그렇게 생각하지 않는 스피노자 같은 사람도 많고 아인슈타인과 스티븐 호킹 같은 과학자들도 자유의지를 부정한 바 있다. 거기에 더해 현대 심리학과 뇌과학은 정밀한 실험을 통해 자유의지가 없다는 실증적 증거까지 제시함으로써 오히려 학계에서는 자유의지 부정론이 주류적 견해로 보인다.

1983년 벤자민 리벳은 소위 ‘리벳 실험’을 통해 인간이 어떤 결정을 하기 약 0.5초 전에 이미 뇌의 준비전위 영역이 발화됐고 이 신호에 따라 뒤늦게 결정과 행동이 이루어졌다면서, 인간의 자유로운 행위처럼 보이는 것이 사실은 무의식에 의해서 이미 다 정해지고 이 무의식의 인도에 따라 뒤늦게 의식적 결정과 행동이 이루어진다고 주장해 큰 충격을 안겼다. 이 실험에 대한 논란이 격화되자 2007년 존 딜란 헤인즈가 시도한 실험은 무려 10초 전에 준비전위의 발화를 밝혀 다시 한번 리벳의 자유의지 부정론을 증명하였다. 이 주장을 일관되게 관철한다면 인간은 무의식에 지배되는 결정론적 도구에 불과하므로 윤리적·법적 책임도 질 필요가 없다는 위험한 생각으로까지 나아가고, 실제로 무신론 철학자 샘 해리스와 같이 그리 주장하는 사람도 있다.

그러나 이러한 주장에 대해서 나는 동의하지 않는다. 먼저 자유의지 논쟁의 경우 자유의지, 결정, 영향 등 주요 개념들에 대한 통일된 정의가 없는 상태에서 논의가 전개돼 ‘우주적 결정론’부터 ‘뷔리당의 당나귀’까지 논자마다 자신만의 개념으로 논증을 하니 무의미한 주장이 많다. 심리학과 뇌과학적 주장의 경우도 책임주체로서의 나라는 인간의 본질은 뇌, 그 중에서도 판단과 결정 기능을 수행하는 전전두엽뿐이고, 감정과 무의식을 관장하는 편도체 등 변연계는 인간의 본질 내지 내가 아니라는 것인데 수긍하기 어렵다. 우리의 감정과 무의식은 우리가 통제할 수 없는 유전자와 환경적 요인도 물론 있겠지만 대부분 우리 자신의 선택과 습관으로 형성된 것이고 우리는 그로 인한 행위에 대해서 전인격적 책임을 져야 한다. 빅터 프랭클은 자극과 반응 사이에 우리의 선택이라는 작은 공간이 있다고 했고, 저명한 뇌과학자 리사 펠드먼 배럿 또한 우리는 무엇에 자기 자신을 노출시킬 것인지 선택할 수 있으므로 그것을 자유의지라 부르고 책임을 지는 것이 타당하다고 했다.

인공지능의 책임 문제 또한 이러한 논리로 해결되는 것이 바람직하다고 본다. 즉 자의식이 없는 ‘약한 인공지능’의 경우 인간의 통제가 이루어지지 않는 블랙박스 부분(뇌로 말하자면 무의식을 관장하는 변연계 영역)이 있다고 하더라도 블랙박스에서의 결정 메커니즘에 제작자가 어떤 방식으로든 관여할 수밖에 없고, 따라서 그 프로그램은 여전히 제작자와 하나(하나의 뇌)라고 봐야 하므로 제작자가 책임을 지는 것이 타당하다. 사업자가 그 인공지능을 활용해 사업을 하다가 피해를 유발했다면 제작자와 사업자가 연대책임을 지고 상호간 구상으로 해결해야 할 것이다. 그리고 책임의 성격은 인공지능의 블랙박스적 특성을 감안해 자동차손해배상보장법과 같이 무과실책임으로 구성하는 것이 바람직하다. 다만 이로 인해 인공지능의 발전이 저해될 수 있는 경우에는 보험이나 파생상품을 활용해 위험을 분산 내지 이전하는 방식으로 대응할 필요가 있다. 마지막으로 자의식을 가진 ‘강한 인공지능’의 경우는 어쩔 것이냐고 묻는다면 그때도 인류가 살아남아 있겠냐는 답변으로 대신한다.

지금 뜨는 뉴스

성희활 인하대 법학전문대학원 교수

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![[시론] 자유의지 논쟁과 인공지능의 법적 책임](https://cphoto.asiae.co.kr/listimglink/1/2021020115515356195_1612162313.jpg)

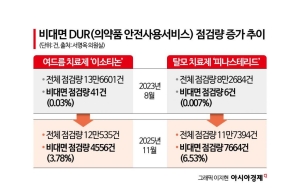

![전문가 4인이 말하는 '의료 생태계의 대전환'[비대면진료의 미래⑥]](https://cwcontent.asiae.co.kr/asiaresize/319/2026013014211022823_1769750471.png)

![[속보]](https://cwcontent.asiae.co.kr/asiaresize/308/2026020911364534184_1770604605.png)