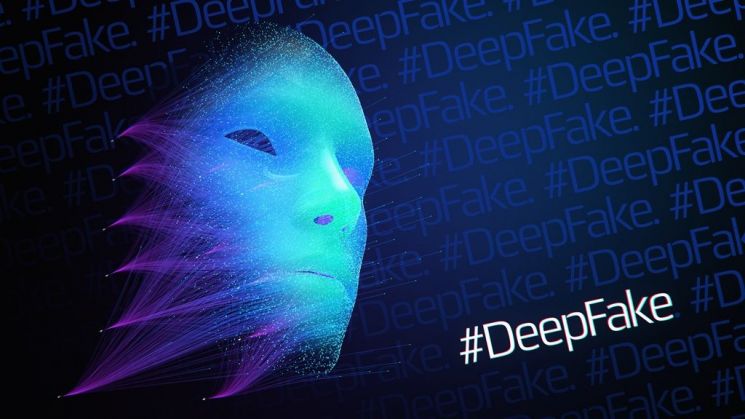

[아시아경제 부애리 기자] 최근 텔레그램 n번방 사건에 이어 한국 연예인 100여명에 대한 '딥페이크(deep fake)' 음란물이 조직적으로 유포됐다는 정황이 포착돼 경찰이 수사에 착수했다. 이처럼 딥페이크 기술을 악용한 사례들이 속출하자 국내 IT 기업들이 조작 여부를 판별할 수 있는 기술 개발에 팔을 걷어 붙였다.

딥페이크는 컴퓨터가 스스로 학습하는 인공지능(AI) 기술인 '딥러닝(deep learning)'과 가짜를 뜻하는 ‘페이크(fake)’의 합성어다. 컴퓨터에 입력된 데이터를 AI가 스스로 분석하고 학습해 진짜와 구별이 힘든 가짜 이미지를 만들어 내는 기술이다.

◆'지인능욕'에서 연예인 합성까지 = 5일 업계에 따르면 소셜네트워크서비스(SNS)에선 여전히 '지인능욕' 등의 내용으로 불법 딥페이크 음란물 영상과 사진이 유통되고 있다.

딥페이크 성범죄가 벌어지는 공간은 텔레그램, 트위터, 인스타그램 등 다양하다. SNS에서 지인능욕을 검색하면 '지인능욕을 해주겠다'고 의뢰를 받거나, 지인능욕을 해달라고 요청하는 글을 어렵지 않게 찾을 수 있다. 모든 여성이 표적이 된다. 남성들은 자신의 친구,가족,지인 등 여성들의 얼굴 사진을 건네면서 음란물에 합성을 의뢰하는 방식이다.

딥페이크 성범죄는 국내 뿐 아니라 세계적으로도 만연해 있다. 네덜란드의 사이버 보안연구 회사인 '딥트레이스'에 따르면 전 세계 딥페이크 영상은 1만5000여개에 달하는 것으로 파악됐다. 딥페이크 영상 중 96%가 음란물이었다. 특히 음란물 합성 피해자의 25%가 한국 여자 연예인이었다.

◆착한 딥페이크 개발 = 문제가 심각해지자 AI 관련 국내 IT기업들은 영상의 조작 여부를 가려내기 위한 딥페이크 검출 기술의 연구 개발에 나섰다.

AI 기업 '머니브레인'은 인공지능 관련 기술력과 인력을 바탕으로 딥페이크 검출 기술 연구에 몰두하고 있다. 머니브레인은 영상의 진위 여부를 판단하는 능력을 갖춘 딥러닝 모델 ‘AI Fake Finder(AI 영상 조작 검출 기술)’를 만드는데 주력하고 있다. 다양한 베이스 모델을 통해 진짜와 가짜를 스스로 판별할 수 있도록 지속적으로 반복 학습 시키는 연구를 진행 중이다.

이외에도 '알엔딥'은 최근 온라인 성폭력과 음란물 유해 사이트를 막는 '레드 AI' 기술 개발을 완료했다. 알엔딥은 이를 기반으로 불법적으로 활용되는 딥페이크 검출 기술과 욕설 방지 기술 개발을 진행 중이다. 알엔딥이 최근 공개한 '레드 AI 모자이크' 기술은 입력된 사진과 영상의 모든 프레임을 검사하고, 주요 노출부위에 대해 모자이크를 자동으로 생성해준다. 문제가 될만한 부분이 포함되면 화면 전체를 블랙으로 처리할 수도 있고, 특정 부위만 흐릿하게 보이게 하는 것도 가능하다.

지금 뜨는 뉴스

장세영 머니브레인 대표이사는 "딥페이크 기술은 성장 잠재력과 효용성이 매우 높은 기술이지만, 악용 방법도 갈수록 교묘해지면서 피해 사례가 급증해 매우 안타깝다"며 "자사가 보유한 기술력을 토대로 딥페이크 기술이 산업의 발전에 이로운 방향으로 활용 될 수 있게 실질적인 해결책을 제시하도록 노력할 것"이라고 말했다.

부애리 기자 aeri345@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![전문가 4인이 말하는 '의료 생태계의 대전환'[비대면진료의 미래⑥]](https://cwcontent.asiae.co.kr/asiaresize/319/2026013014211022823_1769750471.png)

![오입금 된 비트코인 팔아 빚 갚고 유흥비 쓴 이용자…2021년 대법원 판단은[리걸 이슈체크]](https://cwcontent.asiae.co.kr/asiaresize/308/2026021014460536494_1770702365.jpg)