MS 연구진, 300만개 이미지·글 학습시켜 효율화

[아시아경제 이민우 기자] 그림 및 사진과 그 설명을 보고 대화를 나눌 수 있는 인공지능(AI)이 개발됐다.

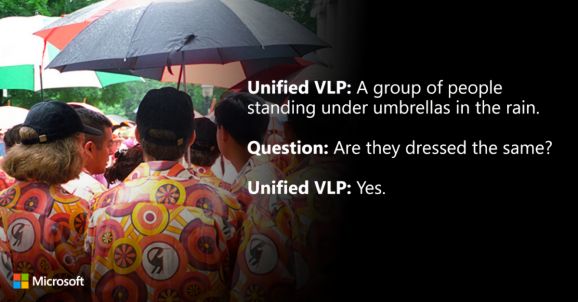

8일(현지시간) 벤처비트 등 정보기술(IT) 전문 외신들에 따르면 마이크로소프트(MS) 연구진은 사람이 사물을 바라보고 인식하는 방식을 본딴 AI 학습모델인 '시각·언어 사전학습모델(VLP)'을 개발했다. 사진이나 영상 등 이미지와 그에 딸린 설명을 학습시킨 뒤 관련 질문에 답하는 방식이다. 예를 들어 '비가 내리는 가운데 여러 사람들이 우산을 들고 있다'라는 설명과 함께 그에 맞는 사진을 제시한 후 '모두 같은 옷을 입고 있는가?'라고 물으면 스스로 사진을 분석해 '그렇다' 또는 '아니다'라고 답할 수 있는 것이다.

하미드 팔랑기 MS 수석연구원은 "주변의 사물과 환경을 이해하는 것은 인간이 어릴적에 겪는 기본적인 학습 과정"이라며 "주변과 상호작용을 늘릴 수록 주변에 있는 사물이나 각종 행동들을 묘사하기 위해 언어를 더 잘 이해하고 사용하게 된다"고 설명했다. 이어 "반면 이 같은 것들을 기계에게 가르치는 것은 무척 어려운 작업"이라고 덧붙였다.

기존에도 유사한 알고리즘이 있었지만 몇가지 과제를 해결하지 못했었다. 이미지를 묘사하고 추론하기 위해 맥락을 이해할 수 없는데다, 사전 학습을 위한 대규모 데이터를 확보하기 어려웠다. 팔랑기 연구원은 "우리는 이 같은 문제를 해결하기 위해 수많은 표현을 학습한 입력기(인코더)와 입력기의 표현을 인간이 이해할 수 있는 형태로 제공하는 변환기(디코더), 이 두가지를 결합해 최적의 결과물을 뽑아낼 수 있는 사전학습모델 등을 마련했다"고 설명했다.

MS연구진들은 VLP모델이 다양한 분야에서 보다 저렴한 비용으로 활용될 수 있을 것이라고 전망하고 있다. 300만개의 영상과 설명 묶음을 학습한 이 모델은 현재 세계 최대 오픈소스(소스코드 무료로 공개) 사이트 '깃허브'에 공개된 상태다. 연구진은 향후 사전 학습에 더 많은 데이터를 추가하는 동시에 모델 아키텍쳐를 강화해 나아갈 계획이다.

이민우 기자 letzwin@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

![전문가 4인이 말하는 '의료 생태계의 대전환'[비대면진료의 미래⑥]](https://cwcontent.asiae.co.kr/asiaresize/319/2026013014211022823_1769750471.png)