음성·청각 장애들도 실시간 의사소통 가능

사생활 보호 기능도 추가…

![[구글 I/O] "全인류가 구글 맛보는 세상 만들겠다"…장애인 돕는 AI기술 대거 공개](https://cphoto.asiae.co.kr/listimglink/1/2019050806094111928_1557263381.jpg) 순다 피차이 최고경영자(CEO)가 7일(현지시간) 미국 캘리포니아주 마운틴뷰에서 열린 연례 개발자 회의 '구글 I/O 2019'의 기조연설을 하고 있다.

순다 피차이 최고경영자(CEO)가 7일(현지시간) 미국 캘리포니아주 마운틴뷰에서 열린 연례 개발자 회의 '구글 I/O 2019'의 기조연설을 하고 있다.

[마운틴뷰(미국)=아시아경제 이민우 기자] "모든 이들을 위한 인공지능(AI)을 구현하겠다."

구글의 수장 순다 피차이 최고경영자(CEO)는 7일(현지시간) 미국 캘리포니아주 마운틴뷰에서 열린 연례 개발자 회의 '구글 I/O 2019'의 기조연설에서 이 같이 강조했다. 피차이 CEO는 "AI를 학습시키면서 편견이 섞이지 않도록 하는 것은 매우 중요하면서도 어려운 일"이라며 "사생활 보호와 보안까지 모두 지켜나가는 한편 장애와 어려움을 가진 이들을 도울 수 있는 AI를 지속적으로 개발해낼 것"이라고 강조했다.

실제로 이날 소개된 AI 신기술에는 장애인과 같이 어려운 환경에 처한 이들을 돕기 위한 기술을 개발하는 '유포니아(Euphonia)' 프로젝트팀의 사례가 대거 포함됐다.

선천적으로 발음이 부정확해 말을 하기 어려운 이들을 위한 '라이브 트랜스크라이브' 기능이 대표적이다. 특히 이 기능은 이 같은 장애를 겪고 있는 구글의 음성언어연구자 디미트리 카네프스키가 직접 참여해 개발했다. 부정확한 발음을 수 차례 AI에게 들려주며 학습시킨 뒤 이를 완벽히 문자로 구현할 수 있도록 설계했다. 그 결과 구글 AI는 그의 발음을 완벽히 알아듣고 실시간으로 받아적어 보여준다.

그 밖에도 눈빛이나 기침 소리로 밖에 의사 표현을 할 수 없는 이들에게도 이 같은 기술을 적용했다. 기침소리 또는 눈빛의 형태와 길이를 정밀히 분석해 이를 문자로 나타낸 것이다. 줄리 카티오 구글 AI 프로덕트 매니저는 "숨소리나 눈으로 응시하는 것으로만 자신의 의사를 제한적으로 표현해야 했던 사람들도 환희할 수 있고 다양한 의사 표현을 할 수 있게된 셈"이라고 설명했다.

사생활 보호가 강화된 기능도 추가됐다. 전화통화 내용이 외부에 유출되기 싫을 경우 '라이브 리플라이'을 이용하면 된다. 문자로 입력하면 AI 비서가 이를 읽어 대신 통화해주는 식이다. 주위 사람들에게 방해를 끼치지 않기 위한 라이브캡션 기능도 소개됐다. 일종의 자동자막 프로그램이다. 영상통화를 할 때 상대방이 한 말이 실시간 자막으로 나타나는 식이다. 반대로 화면을 비추고 말하면 자동으로 음성이 자막으로 입력되기도 한다.

지금 뜨는 뉴스

피차이 CEO는 "AI를 통해 읽을 수 있고 볼 수 있고 소통할 수 있는 범위가 늘어날 것"이라며 "삶의 가능성이 새롭게 열리는 셈"이라고 했다.

이민우 기자 letzwin@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제(www.asiae.co.kr) 무단전재 배포금지>

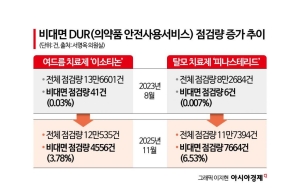

![전문가 4인이 말하는 '의료 생태계의 대전환'[비대면진료의 미래⑥]](https://cwcontent.asiae.co.kr/asiaresize/319/2026013014211022823_1769750471.png)